AI監管進度落後X地緣政治蔓延 全球AI治理淪意識形態對抗

- 撰文者:

- 2023/12/07 瀏覽數:720

重點摘要

- AI技術的快速進展影響全人類,各項風險也已逐漸浮現,AI系統開發者必須與政策制定者合作,加快發展AI管理系統。

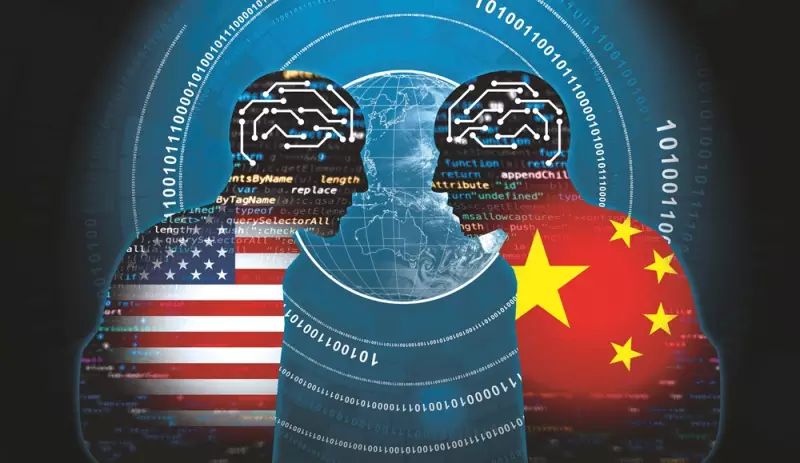

- 中美間的地緣政治競爭,延伸到AI領域,在民主價值與中國、俄羅斯的對抗下,全球化的AI監管面臨僵局。

- 美中在推行具法律拘束力的AI法案進度落後,歐盟已進入立法的最後階段討論。

- AI監管需全球參與,歐美與中國在意識形態上存在巨大差異,難就人工智慧與中國達成有意義且實質的規則。

【文/馮震宇 圖片提供/達志影像】

在ChatGPT引爆全球AI熱潮後,有鑑於AI技術快速發展對人類可能的影響,國際社會終於在AI觀念出現70年之後開始推動AI治理,並嘗試以法律及行政手段雙管齊下的方式,對先進AI技術發展與應用進行監管。

但在最需要國際合作的當下,地緣政治卻成為AI全球治理的不確定因素,在美國結合盟友對中國AI發展予以封鎖之際,美中兩大AI強國卻各自推出不同的倡議規劃,而歐洲則持續推動以法律對AI加以監管,此三分天下之態勢也突顯達成AI全球治理的挑戰。

AI進程極速狂飆

企業也呼籲監管AI

根據美國卡內基基金會的研究,用於訓練A I 系統的運算能力在10年間增加了5,500萬倍,下一代的尖端模型能以較目前GPT-4更快10倍的運算能力進行訓練,也因此有專家估計,在2030年以前將會出現人類難以控制的AI系統,除非國際社會能迅速建立適當的保障措施和政策回應,否則AI將會為人類社會帶來新的風險,也將對AI治理帶來更大的挑戰。

甚至剛被OpenAI董事會罷黜的前執行長阿特曼(Altman) 在今年5月於美國國會作證時,就呼籲美國國會對AI進行監管。他指出,生成式AI雖能夠改善工作效率與創造新工作,但他也對AI可能對世界帶來的風險深感憂心。也因此他明確的表示,政府的監管對於減輕日益強大的AI 模型所帶來的風險至關重要,希望能與政府合作,防範新技術發生問題。

隨著先進的AI系統以驚人的速度席捲全球,阿特曼的擔憂也迅速成為現實,世界各地不斷出現案例,如運用AI技術製造與散播虛假訊息、深偽(Deep Fake) 變音、侵害隱私、破解密碼與其他各種不法情事,就可以理解能力超強且不受規範的AI在社會各個層面所可能造成的影響。國際社會極需以負責任的態度面對AI 潛在風險,提早因應AI發展所可能造成的傷害,方能確實善用AI 帶來的機會與挑戰。

中美角力影響AI監管

國家安全圍堵延伸至AI

面對如此變局,國際間卻對如何因應AI快速發展,以及加以監管等關鍵問題進度緩慢。美國雖在2023年2月舉行「軍事領域負責任使用AI峰會」上,提出《關於負責任地在軍事領域使用AI和自主技術的政治宣言》,希望達成在AI在軍事發展和部署方面之國際共識,以維持國際法、國際安全與穩定,但迄今只有36國支持這項宣言。更重要的,在最需國際合作共同推動全球AI治理之際,美國卻聯合盟友開展對中國科技的圍堵並擴大國家安全至AI領域,也對達成全球AI治理與AI監管帶來一定的影響。雖美中兩國元首近日在APEC會議前舉行拜席會,為緩和大國競爭提供了一個機會,但仍無法打破地緣政治的緊箍咒。

例如美國在拜席會前,即放話稱雙方將在頭方面達成共識,最終雙方只同意在AI領域進行最低限度地合作,以防範這項技術用於軍事甚至核武,在AI技術與無人機方面,未能達成協議。在軍事運用以外的其他領域,雖然各國政府並未採取積極的措施,但非營利NGO團體則率先跳出來大聲疾呼,使得對AI技術加以監管的音量逐漸擴大,進而影響到全世界。例如非營利組織「未來生命研究所」(Future of Life Institute)擔心AI技術的快速進展必然會影響整個人類,就在2023年3月發表公開信,呼籲OpenAI暫緩訓練比GPT-4更高階的AI系統6個月。

AI將影響人類生存

美處領先地位傾向放任

這封公開信主張高級AI可能意謂著地球生命史上的深刻變化,應該投入相應的考量和資源,對之進行規劃和管理,並指出AI 的三大問題,包括:

- AI技術未能公開透明使生成式AI存在風險。

- OpenAI產品介面存有重大隱私瑕疵,會因快取而暴露使用者與ChatGPT的聊天紀錄甚至付款資料。

- 風險倫理評估無法跟上模型開發與產品上市速度等問題。

為此, 這封公開信呼籲AI系統開發者必須與政策制定者合作,加快發展AI管理系統。而未來的AI管理系統至少應該包括:「專門負責監管AI的機構、區分真實與AI生成內容的來源和浮水印系統、強大的審計和認證系統。」此外,還應明確對AI造成之損害訂定責任歸屬規則,並為AI安全技術研究提供強大的公共資金。

這封公開信一經公開,就在短短3周內獲得包括圖靈獎得主Yoshua Bengio、Stability AI首席執行官Emad Mostaque、蘋果聯合創始人Steve Wozniak、馬斯克等知名人士在內的31,810人連署,顯現出民間對AI治理的重視。

而民間非營利團體積極推動此等議題,也相對突顯出美國政府的不作為。主要因為全球領先的AI業者,均為美國公司,因此美國政府的態度也一如網路發展初期,對此新興技術的發展採取放任政策,以免阻撓美國企業在全球的發展。

因此到GPT-4出現之前, 美國聯邦政府僅在2022年10月提出了一項屬政策聲明性質的《AI 權利法案》(Artificial Intelligence Bill of Rights),涵蓋建立安全有效的系統、保護民眾免於演算法歧視、維護數據隱私、自動化系統運作透明化、保障退出權與尋求協助管道等5大面向。但由於其僅具有自願遵循性質,並不具有法律拘束力,故並未能對各大科技巨頭與AI新創公司產生實質的影響。

各國AI應對作為

美中外各國積極行動

相對於美中兩大AI技術強國的吝於表態,G7則在2023年5月20日舉行的廣島峰會上達成共識,認同為發展值得信賴的AI技術,各國應開發並施行一套符合G7民主價值觀的國際技術與監管標準,以規範AI的應用。其具體內容包括公平、問責機制、透明度、防止網路霸凌以及尊重個人隱私權和人權。為此,G7還建立「廣島人工智慧進程」(Hiroshima AI Process) 以討論AI 相關事務,並預計在2023年底發佈報告。

緊接著,聯合國也在2023年10月任命了一個國際專家小組,就人工智慧治理議題向秘書長提供建議,並規劃出聯合國的AI 治理路線圖。

歐盟作為

2021年提出具法律效力的AI法案

歐洲是對AI技術發展與應用最為關切的區域。歐盟執委會早在2018年6月就成立人工智慧高級專家組,並在2019年4月提出「可信賴的人工智慧倫理準則」(Ethics Guidelines for Trustworthy AI),要求AI需遵守人類自主、傷害預防、公平、透明公開等倫理原則。

更重要的,就是歐盟執委會在2021年4月提出具有法律拘束力的「人工智慧法律調和規則」(簡稱人工智慧法案Artificial Intelligence Act)的草案,經2年的協商後,在2023年連闖兩關,通過內部市場委員會與歐洲議會審議,正式進入立法最後階段的三方協商(Trilogue,即歐洲議會、歐洲聯盟理事會和歐洲委員會之間的三方討論)階段。該草案將AI 應用技術劃分為「低風險」、「高風險」以及「不可接受」等3 個風險等級。

其中,生物辨識系統,包括人臉辨識系統的應用被列為「不可接受」,法案將徹底禁止各國使用生物及人臉辨識系統。此外,利用AI 系統影響選舉則被列為「高風險」,各國應嚴格限制、審查該行為。對違反該法案內容者,最高將可以被處4,000萬歐元或公司全球營業額7% 的罰款。

原本該草案預計將在2023年底完成協商並正式生效,但由於歐洲議會在6月所通過的草案僅先針對大型基礎AI系統進行監管,並未對所有AI業者加以規範,以至於在三方協商中出現僵局。例如德、法、義3國認為,該法應對所有AI業者都適用,不應僅限於大型基礎AI系統。

此外,草案全面禁止人臉辨識技術,但許多歐盟國家則表示反對。目前西班牙已提出妥協方案,要求對語言模型的漏洞進行更頻繁的審查,並建立一個類似《歐盟數位服務法》(DSA)的機制,也就是根據用戶數量進行分級監管,並將在12月召開第四次三方協商會議,若在12月仍無法突破僵局,該法案即必然會被推遲。

美國作為

AI 系統開發者需與美政府共享安全與重大資訊

相對於歐洲積極推動具法律拘束力的AI 法案,美國總統拜登遲至2023年10月30日才簽署首項關於人工智慧行政命令。白宮表示,為了確保風險管控和創新發展並存,「我們必須管理這項技術」。

此項行政命令涵蓋8個面向,包括建立AI安全新標準、保護美國人隱私、促進公平和公民權利、支持消費者病患與學生、支持勞工、推動創新與競爭、提昇美國在海外的領導地位、以G7 AI宣言中直白表示,應施行一套「符合G7民主價值觀」的國際技術與監管標準,讓美國和歐盟很難就人工智慧與中國達成有意義且實質的規則。

及確保政府負責任及有效地使用AI。其中最關鍵的就是建立AI安全新標準,其具體措施包括要求最強大(Most Powerful) AI系統的開發者必須與美國政府分享其安全測試結構與其它重大資訊;必須發展各式標準、工具與測試來協助確保AI 系統的安全性與可靠性;制定強大的標準來監控生物合成,避免利用AI設計出危險的生物材料;建立如何分辨AI生成內容與官方內容的偵測機制與最佳實施例,以避免人們遭到AI詐騙;開發AI工具來發現及修補重大軟體中的安全漏洞。

而在這項行政命令公佈後,YouTube 就宣佈將對YouTube影片新增AI生成標籤,創作者若拒絕揭露,將會面臨停權下架的風險。其具體做法就是YouTube將提供新選項,要求創作者在上傳內容時,揭露相關內容是否經過變造、合成或使用AI工具生成。若內容係由AI產生、數位合成或修改,YouTube將在說明面板中新增標籤,標示部分內容係經過數位修改或生成;若影片內容涉及臉孔、聲音等可辨識之個人身分內容,受影響者還能根據隱私權申訴程序要求移除。

中國作為

支持在聯合國框架下討論成立國際AI治理機構

至於中國,則是在2023年10月18日於一帶一路高峰論壇上發佈了「全球人工智能治理倡議」,提出中國對全球AI治理的方案。該倡議以AI發展、安全、治理為核心,闡述中國對AI治理的態度,重點包括:堅持相互尊重、平等互利,反對惡意阻撓他國AI發展;主張建立AI風險等級測試評估體系,不斷提昇AI技術的安全性、可靠性、可控性、公平性;支持在充分尊重各國政策和實踐基礎上,形成具有廣泛共識的全球AI治理框架和標準規範。

更重要的,就是中國表態支持在聯合國框架下討論成立國際AI治理機構。但五眼聯盟則選在同一天以中國對全球創新構成「前所未有的威脅」為由發表共同聲明,指責中國利用AI竊取智慧財產權,使用AI 進行駭客攻擊和間諜活動。

英國作為

舉辦全球第一次「人工智慧安全峰會」

而英國則在達成國際對AI安全監管方面,踏出了重要的一步。在2023年11月1日,英國於二戰時期盟軍密碼解讀重鎮的英格蘭「布萊切利公園」(Bletchley Park) 舉辦了第一次全球「人工智慧安全峰會」(AI Safety Summit),除強調AI 在全球帶來的風險,並呼籲國際合作以應對這些挑戰,而會議的結論也為國際AI 安全制度奠定初步基礎。

這場峰會主要在於呼應科技界對AI監管的倡議,並將重點置於先進AI 風險的議題上,例如AI對人類社會的威脅與網路安全等議題。所有參與國(包括歐盟、英國、美國與中國等28國)與全球領先AI公司還在峰會召開前發佈「布萊切利宣言」(Bletchley Declaration),特別強調發展AI所需面對的風險與應考量的議題,例如指出AI所帶來的許多風險基本上是國際性的,應透過國際合作來解決,各國應同時考慮推動創新及相對應的監管架構,以最大化AI的好處並管理風險。

此外,該峰會還支持2018年圖靈獎得主、聯合國科學顧問委員會成員Yoshua Bengio領導的國際科學家小組發布首份AI安全報告,以確定進一步研究的優先領域,並作為成立一個永久的國際人工智慧安全小組(IPAIS) 的第一步。

雖然各國在該峰會就AI 安全監管的必要性達成一些共識,但對於如何具體實現,以及由誰領導執行計畫仍存在分歧,而英國對中國的態度與拜席會達成的有限度合作,也進一步突顯在地緣政治衝突下,達成國際AI安全監管目標的困難。這是因為雖然英國邀請中國與會,但卻以安全為由,限制中國代表團的參與,使得中國代表團在第一天會議結束後就提前打包走人。

監管涉價值對抗

民主陣營 VS. 中國

而歐美與中國就有關AI 監管與治理態度的差異與競爭關係,其實已在相關國際會議中表露無遺。例如G7在其AI宣言中就直白的表示,各國應開發並施行一套「符合G7民主價值觀」的國際技術與監管標準。而在2023年9月於布魯塞爾舉行的歐洲新聞國際AI 峰會的討論中,大多數參加的專家也都認為,在AI標準方面與中國合作的可能非常低。

美國哥倫比亞法學院Bradford 教授在接受歐洲Euronews 訪問時更點出問題的核心。他指出,「我認為可以公平地說,地緣政治現實不太有利於深入、有意義的合作。」由於美國和中國之間的科技戰不斷升級,出現一場激烈的技術霸主競賽,使得人們對誰是經濟強國、科技強國、地緣政治強國特別關切,再加上兩國在意識形態上也存在巨大差異,「因此,美國和歐盟很難就人工智慧與中國達成有意義且實質的規則。」

而歐洲議會負責歐盟AI法案的歐洲議會議員Drago Tudorache 在接受EuroNews訪問時也表示,目前談與中國在AI方面的合作過早,且應該是次要的,因為西方國家應先達成共識後再與中國進行對話。

也因此從目前國際現狀觀察,由於無法在短期內就全球AI治理達成共識,或將仍維持由各國各自努力再徐圖發展的局面,而歐盟仍將會努力完成AI法案,對全球AI 發展與應用投射歐盟的價值觀。

台灣可以做什麼

訓練資料獲取合法性

但就我國而言,台灣身為全球AI算力最重要供應者,必須積極參與國際AI 治理與監管的各種會議與活動,以洞察全球AI治理與監管趨勢,並應兼顧AI技術創新與保護AI利用者。而其中最重要的發展,應該就是國科會正大力推動的《人工智慧基本法》草案。

該法將對隱私保護、資料治理、風險管控、倫理原則規範、產業推動,以及AI 應用的遵法與合法性等面向加以規範。但是由於AI技術與應用仍在快速發展,且國際間尚未能就全球AI治理達成共識的情況下,台灣是否要超前部署,率先訂定人工智慧專法,就值得深思。

其實與其超前立法,還不如反思應如何完善現有法規架構。而其中一個可以思考的方向,就是如何降低取得高品質AI 訓練資料的困難度,以及如何降低訓練AI語言模型時違反著作權法與個資法的法律風險,例如可考慮引進歐盟著作權指令之資料探勘(Text and Data Mining, TDM) 例外,以便利台灣AI業者能合法取得資料用於AI訓練,並致力於與台灣產業緊密結合的AI技術開發和應用,或許將會更有助於台灣在全球AI治理架構內發光發熱。(本文作者為政治大學法學院暨商學院合聘教授)

【更多精彩內容請見《能力雜誌》2023年12月號,非經同意不得轉載、刊登】

能力雜誌

《能力雜誌》(Learning & Development),為中國生產力中心的出版媒體,以打造「經營管理的品牌+職場價值的推手」為編輯宗旨,提供讀者學得來的經管知識,以及容易用的職場技能,幫助讀者成為能動、能靜、能自主學習的職場菁英、專業經理人。

猜你喜歡

近年來,隨著神經網路、深度學習等演算法的突破,大數據與運算能力的加速整合,及物聯網與感知系統的興起,帶動AI技術與產業的蓬勃發展,AI已經無所不在地存在於我們周遭環境中。且世界各國為了順應智慧化時代的來臨,紛紛投入AI的研究,甚至提升到國家戰略層級,就是為了在此AI浪潮中佔有一席之地,甚至是領頭羊的地位。因此,台灣為了在這波AI浪潮上站穩腳步,在發展AI技術時,應緊扣著我國既有產業優勢之方向開展,善用各領域優勢,以創造多元AI應用服務與價值。為實現我國未來朝向智慧化社會邁進之目標,更應進一步思考如何善用我國優勢打造優勢環境。

AI可能導致的各種問題已開始受到各方的關注,國際間甚至出現暫緩AI發展的呼聲及行動,這使得原本僅存在企業界層面、屬於自律功能的負責任AI,提昇到國家、甚至國際的層次,蛻變為法律所強制要求的AI應負責任。

急救人員安全衛生教育訓練班(南科班) - 夜間班 - 兩人以上優惠價,每人3100元 - 請勿繳費待上課通知

上課時間 2026/03/25 ~ 2026/03/31

整合財務與管理報表創造經營成效 - 本課程為會計主管每年12小時持續專業進修認證課程

上課時間 2026/09/15 ~ 2026/09/15

溫室氣體盤查議定書(GHG Protocol)基礎與實務 - 請攜帶筆電 - 實體上課與視訊同步

上課時間 2026/09/07 ~ 2026/09/08

臺灣職安卡--營造作業一般安全衛生教育訓練6小時 - 5/13 - 限本國籍 - 台灣職安卡初訓 - 台北承德教室

上課時間 2026/05/13 ~ 2026/05/13

生產機台、模具的預知性與預防性保養

上課時間 2026/11/09 ~ 2026/11/09

有機溶劑作業主管安全衛生教育訓練課程 - 【台南日間班】 - 雙人以上優惠價! - 考試:5/13起~ - 待課程確定後再行繳費

上課時間 2026/04/14 ~ 2026/04/17

新版ISO 45001:2018職業安全衛生管理系統內部稽核員培訓班 - 需考試

上課時間 2026/09/15 ~ 2026/09/16

永續報告書工作坊 -GRI準則解析與實務導入 - 實體+線上同步

上課時間 2026/10/16 ~ 2026/10/19

有效掌握現場管理工作實務運用訓練 - 達開班門檻

上課時間 2026/04/27 ~ 2026/04/27

B2B關鍵客戶關鍵時刻管理

上課時間 2026/09/09 ~ 2026/09/09